최근 몇 년 사이 인공지능 기술이 발달하면서 이를 활용한 딥페이크 영상이 사회 문제로 떠오르고 있다. 딥페이크(deepfake)는 딥러닝(deep learning)과 가짜(fake)의 합성어로, 딥페이크 영상은 인공지능 기술을 사용하여 실제 사람의 얼굴이나 신체, 목소리를 다른 영상에 합성한 가짜 영상(또는 이미지, 음성)을 의미한다. 유명인의 얼굴을 합성하여 허위 영상을 만드는 사례가 늘면서 대중은 수시로 진짜와 가짜를 구분하고 의심해야 하는 시대를 살고 있다.

의료 영상 전문가는 가짜와 진짜를 구분할 수 있을까

딥페이크 영상이 이제는 의료 분야에도 침투하고 있다. 전문가들은 가짜 의료 영상이 불법 보험 청구나 범죄에 악용될 수 있다고 우려한다. 이러한 공포가 현실인지 확인하기 위해 미국 마운트 시나이 병원의 아이칸 의과대학 연구진은 인공지능이 만든 X선 영상과 실제 영상을 판별하는 대규모 실험을 진행하여 최근 국제 학술지 Radiology에 발표하였다. 연구를 주도한 타울리 의학박사는 미국, 프랑스, 독일 등 6개국 17명의 현직 방사선 전문의를 대상으로 인공지능이 생성한 가짜 X선 이미지를 실제 의료 영상과 섞어 놓았을 때 이를 구별할 수 있는지 테스트해 보았다.

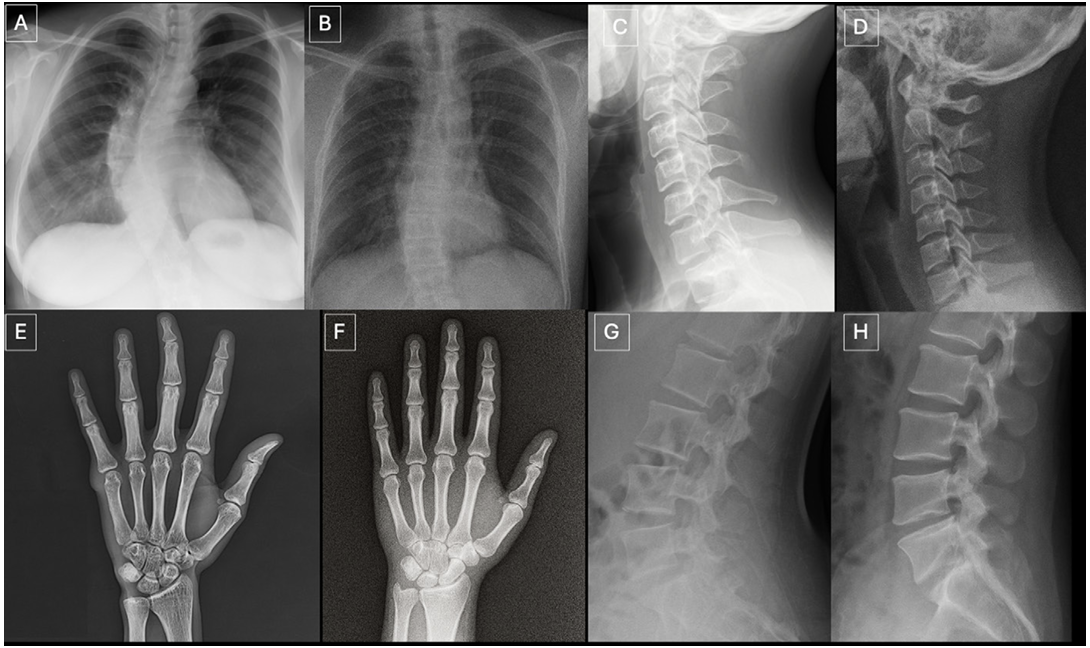

첫 번째 실험은 흉부, 척추, 손과 같은 다양한 부위의 X선 이미지 154장을 무작위로 보여주면서 이미지의 품질과 진단 가능성을 평가하도록 하였다. 이 중 절반은 ChatGPT-4o가 생성한 가짜 이미지이고 나머지 절반은 실제 환자의 영상이었다. 첫 번째 실험에서는 참가자들에게 연구의 목적을 알리지 않은 채 각 이미지의 화질을 평가하고 진단을 기록하게 하였으며, 마지막에 자유롭게 이 이미지에서 이상한 점이 있었는지 묻는 질문을 남겨두었다.

그 결과 해당 이미지들이 합성일 수 있다는 사실을 모른 채 검토한 17명의 방사선 전문의들 가운데 41%(7명)만이 인공지능으로 만든 가짜 이미지가 섞여 있다는 의심을 제기하였다. 합성 이미지와 실제 이미지에 대한 진단 정확도는 각각 92.4%와 91.3%로 유의미한 차이가 없었고 이미지의 화질 평가 역시 거의 비슷하였다. 딥페이크로 생성된 X선 이미지가 전체적인 품질 평가나 병변 진단을 하는 데 있어 전문가에게 거의 들키지 않은 것이다.

사람도 AI도 완벽하게 구분하지 못하다

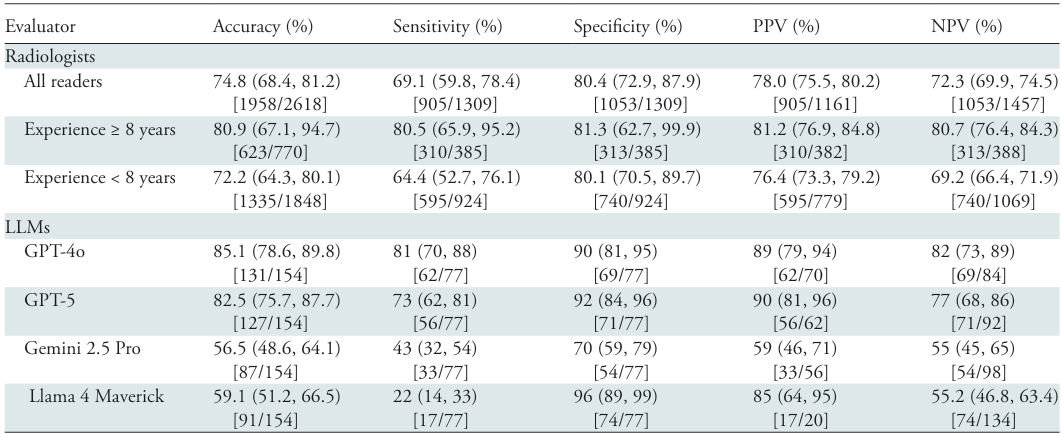

두 번째 실험에서는 참가자들에게 데이터 세트에 합성 이미지가 포함되어 있음을 알리고 각 이미지가 진짜인지, 인공지능으로 생성된 것인지를 분류하도록 하였다. 그 결과 방사선 전문의들이 진짜와 가짜를 구분하는 평균 정확도는 74.8%로, 특이도(진짜를 진짜로 맞히는 비율) 80.4%, 민감도(가짜를 가짜로 맞히는 비율) 69.1%를 기록했다. 참가자 17명의 구분 정확도는 최저 58%에서 최고 92%까지 넓게 분포하였으며 경력 연수(8년 이상 vs 8년 미만)와 정확도 사이에는 상관관계가 없었다.

연구진은 여기서 한 걸음 더 나아가, 인공지능에서도 동일한 테스트를 해보았다. GPT-4o, GPT-5, 구글의 Gemini 2.5 Pro, 메타의 Llama 4 Maverick 등 최신 대형 언어 모델에게도 동일한 데이터 세트를 보여주고 해당 이미지들이 진짜인지 가짜인지 구별하도록 한 것이다. 그 결과 GPT-4o는 85.1%, GPT-5는 82.5%의 정확도를 보여 방사선 전문의보다 약간 높은 성능을 보였지만, 그럼에도 불구하고 모든 이미지를 정확히 구별하지는 못했다. Gemini와 Llama는 각각 56.5%, 59.1%의 정확도를 보여 사실상 무작위 수준에 가까운 결과를 보였다. 인공지능이 만든 가짜 이미지를 인공지능조차 완벽하게 구별하지 못하는 상황이 펼쳐진 것이다.

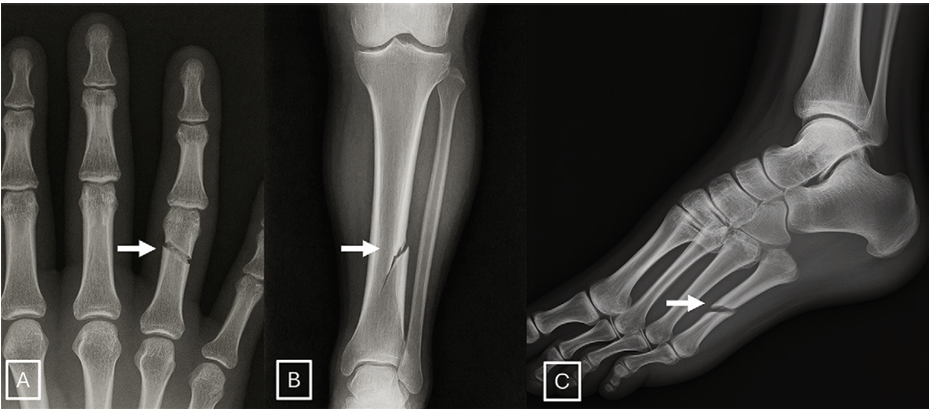

그렇다면 전문가들은 어떤 단서를 통해 합성 이미지를 판별해 낼 수 있었을까? 설문 결과에 따르면 인공지능이 생성한 X선 이미지에는 몇 가지 공통적인 특징이 있었다. 예를 들어 뼈 표면이 지나치게 매끄럽고 조직의 질감이 균일하며 노이즈 패턴이 너무 일정한 경우가 많았다. 또한 척추가 지나치게 완벽한 대칭을 이루거나 골절선이 실제보다 훨씬 깔끔하게 나타나는 경우도 있었다. 쉽게 말해, 너무 완벽한 이미지가 오히려 가짜일 가능성을 높였던 것이다.

너무 완벽한 이미지가 오히려 가짜일 가능성 높아

연구팀은 이러한 결과가 연구 윤리를 넘어 환자의 안전과 의료 시스템 전반에 심각한 영향을 미칠 수 있다고 경고한다. 미국방사선학회는 ‘딥페이크 X선은 최고 수준으로 훈련받은 전문의도 속일 만큼 실제와 구분이 어려워 소송 자료 조작이나 보험 사기를 가능하게 한다’고 말했다. 과학 논문이나 데이터 세트에 합성 이미지가 유입될 경우, 연구 윤리에 문제가 됨은 물론 인공지능 모델 학습 자체가 왜곡될 수도 있다. 실제 환자가 아닌 가짜 패턴을 학습하게 되면 이후 진단 과정에서도 오류가 발생할 가능성이 있기 때문이다.

동시에 생성형 AI가 의료 영상 분야에서 완전히 부정적이지만은 않다는 점도 주목할 만하다. 실제 환자 데이터가 부족한 희귀 질환이나 특정 상황의 이미지를 인공지능으로 만들어 의료인 교육에 필요한 자료로 활용하거나 AI 진단 모델의 학습을 도울 수도 있다. 다만 이 경우에도 안전한 합성 데이터와 악의적인 딥페이크는 구분해야 한다. 연구자들은 투명성과 검증의 중요성을 강조하며, 의료 영상 분야에서 딥페이크를 식별하기 위한 교육, 워터마킹, 데이터 세트 관리 같은 대응 전략이 필요하다고 제안한다.

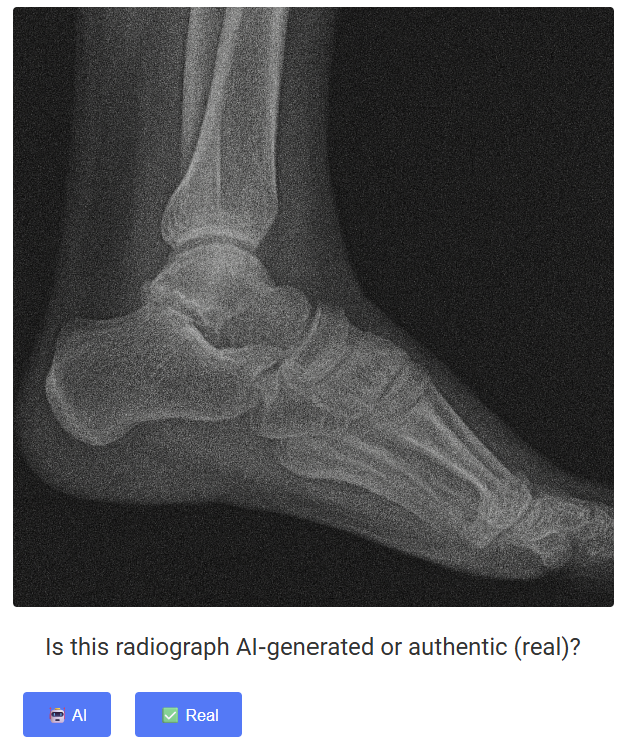

연구팀은 논문과 함께 학습용 딥페이크 X선 데이터 세트도 공개했다. 직접 들어가 진짜 영상과 가짜 영상을 맞춰보면 의료영상 딥페이크가 얼마나 정교한지 체감할 수 있을 것이다.

관련 연구 바로 보러 가기

- 정회빈 리포터

- acochi@hanmail.net

- 저작권자 2026-04-07 ⓒ ScienceTimes

관련기사

뉴스레터

뉴스레터