최근 유튜브 등을 통해 가짜 동영상 뉴스들이 번지고 있다.

문제는 그 내용이 장난 수준을 넘어섰다는 점이다. 전 미국 대통령이었던 오바마가 현 미국 대통령인 트럼프를 향해 전혀 쓸모없는 사람이라고 외치는 장면까지 나왔다.

이에 미 정부가 가짜 비디오에 대처하기 위한 본격적인 움직임에 나서고 있다. 미 국방성에서 가짜뉴스 식별 전담팀을 구성한 것.

미 국방성은 또 수천만 달러를 투입, 가짜 동영상을 식별할 수 있는 기술을 개발 중이다.

“가짜 동영상 퇴치는 국가 안보의 문제”

국방성에서 이 일을 맡고 있는 곳은 DARPA(국방고등연구기획청)다. 이곳에서 기술개발 책임을 맡고 있는 인물은 매트 투레크(Matt Turek) 박사다.

그는 18일 캐나다 라디오 방송인 ‘CVC’에 출연해 “가짜 동영상을 만들기는 쉽지만 가짜 동영상을 식별해내는 일은 매우 힘들다”고 말했다. “그러나 이를 구분하는 포렌식 기술 개발은 국가 안보를 좌우할 수 있는 매우 중요한 일”이라며 시급성을 강조했다.

DARPA는 지난 2년 간 6800만 달러를 투입, 가짜 동영상을 식별해낼 수 있는 컴퓨터 포렌식(computer forensics) 기술을 개발해왔다.

문제는 속도다. 포렌식 전문가인 미국 다트머스 대학의 헤이니 파리드(Hany Farid) 교수는 얼마 전에 인터넷 상에 유포된 가짜 뉴스를 예를 들었다. 트럼프가 등장해 북한에 핵무기를 발사하겠다고 외치는 동영상이다.

파리드 교수는 “이처럼 심각한 내용의 비디오가 유포될 경우 당사국 사이에 심각한 상황을 초래할 수 있다”고 말하며 “상황이 악화되기 전에 이 동영상이 가짜뉴스라는 사실을 서둘러 식별해낼 수 있는 기술이 필요하다”고 강조했다.

가짜뉴스에 대한 포렌식 기술 개발은 4년 계획으로 진행돼 왔으며 현재 3년차로 넘어가고 있는 중이다. DARPA는 향후 2년 안에 이를 완성할 계획이다.

이 기술의 핵심은 동영상 조작 과정에서 발생하는 비연속성(inconsistancies)을 밝혀내는 것이다.

투렉 박사는 “어떤 동영상에 새로운 사람이 움직이는 영상을 추가(합성)했다면 그 이미지 안에 틀림없이 어색한 부분이 포함돼 있다”고 말했다. 사람을 비춘 빛의 각도, 명암의 차이 같은 것들을 말한다.

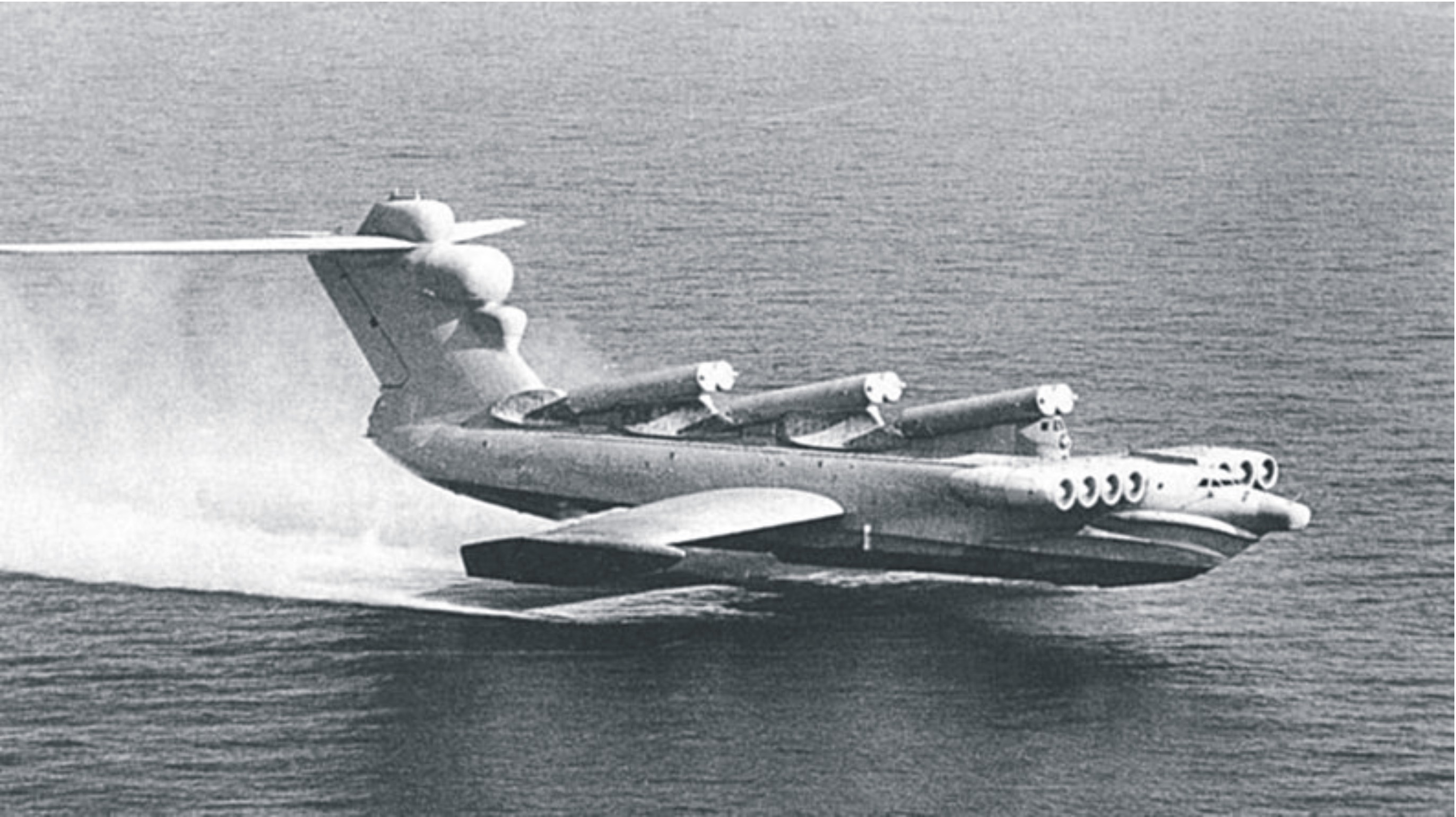

문제는 감시영상(surveillance video)를 흉내 낸 가짜뉴스 들이다. 밤에 촬영한 적외선 영상 등은 화면이 붉은데다 화질이 좋지 않은 것이 대부분이다. 때문에 어떤 부분이 잘려 나가도 사람들이 그저 화질이 좋지않은 감시영상이라 생각하고 의심하지 않는다는 것이 투렉 박사의 분석이다.

투렉 박사는 “그러나 새로 개발하고 있는 포렌식 기술은 이들 가짜 감시영상들을 정밀 분석해 실제 감시영상과의 미세한 차이점을 자동적으로 도출해낼 수 있다”고 말했다.

"가짜와의 전쟁은 끝나지 않는 전쟁"

DARPA의 자신감에도 불구하고 상황은 더욱 악화되고 있는 중이다. 파리드 교수는 “지금처럼 가짜 비디오가 등장하고, 뒤늦게 대처하는 식의 패턴이 지속될 경우 승자는 항상 가짜 비디오 제작자”라고 말했다.

“가짜뉴스가 유포될 경우 피해를 막기 위해 항상 더 많은 시간과 노력, 그리고 기술이 투입돼야하기 때문에 시간적으로 방어자들이 수세에 몰리게 된다”는 것.

파리드 교수는 이어 “가짜 비디오를 만드는 사람들이 다수인 반면 포렌식 기술을 개발해야 할 사람은 극소수에 불과하다. 그런데 가짜 비디오 범람에 따라 강대국 간 군비확대 경쟁과 같은 기술개발 경쟁이 불가피하다”고 말했다.

그러나 미 국방성을 비롯 FBI와 같은 수사기관, 법조계, 그리고 미디어를 관장하는 국가기관 등에서는 이 같은 기술개발 경쟁을 반기고 있는 분위기다.

DARPA는 비디오를 대상으로 한 포렌식 기술 개발이 미 국방력에 큰 도움을 줄 것으로 보고 있다. FBI나 법조계 역시 가짜 비디오로 인한 사회적 혼란을 막기 위해 가자 뉴스 식별을 위한 기술 도입을 적극 환영하고 있는 중이다.

그러나 더 큰 걱정은 가짜 비디오를 놓고 벌이는 이 같은 각축전으로 인해 진실한 내용을 담고 있는 동영상이 가짜 동영상과 같은 취급을 받게 된다는 것.

투렉 박사는 “오랜 기간 동안 대중은 인터넷에 올라오는 동영상 내용을 믿어왔다”고 말했다.

그는 “그러나 가짜 동영상이 늘어나면서 그 신뢰감이 무너지고 있다”며, “뛰어난 포렌식 기술 개발을 통해 사회적 신뢰성을 회복하는 일이 무엇보다 시급하다”고 주장했다.

투렉 박사는 이어 “지금 가짜 비디오 생산자들이 우위에 있는 것처럼 보이지만 사회적인 또 다른 관점에서 포렌식 작업을 시도할 경우 우려를 불식할 수 있는 방안이 마련될 수 있다”며 포렌식 기술개발에 대해 적극적인 관심을 가져줄 것을 부탁했다.

파리드 교수는 “가짜 비디오 공세에 직면해 대중 역시 더 현명해질 필요가 있다”고 말했다. 디지털 영상 정보를 접하면서 이전보다 더 이성적(rational)이 될 필요가 있다는 것.

인공지능을 통해 가짜 비디오를 만들어내는 일은 지금 쉬운 일이 됐다. 특히 ‘생성적 적대신경망(GAN)’이라 불리는 기술은 진짜 영상과 가짜 영상을 비교해 깜쪽 같이 가짜 영상을 만들어낼 수 있는 능력을 지니고 있다.

사람 얼굴을 바꾸는 것은 물론 밤과 낮을 바꾸고, 상상 속의 유명인들을 실제 움직이는 것처럼 만들어 낼 수도 있다.

이 기술을 적절히 활용할 경우 과학기술은 물론 사회‧경제적으로 큰 도움을 줄 수 있을 것이다. 그러나 인터넷 상에 범람하는 가짜 뉴스 문제를 먼저 해결해야 한다. 인간과 바이러스 간의 경쟁과 같은 이러한 양상이 어떻게 해결될 수 있을지 관심이 모아지고 있다.

- 이강봉 객원기자

- aacc409@naver.com

- 저작권자 2018-11-19 ⓒ ScienceTimes

관련기사

뉴스레터

뉴스레터